Wind River und T-Systems liefern 5G-Cloud-Netzmanagement

Die Deutsche Telekom bietet mit „EdgAir“ ein System an, das eine extrem niedriger Latenz für sicheres und leistungsfähiges Edge Computing aufweisen soll. Es ermögliche somit Echtzeit-Anwendungen in Produktion und Logistik. Die sichere und leistungsstarke Edge-Computing-Plattform greift dabei auf die Edge-Cloud-Infrastruktursoftware Wind River Cloud Platform zurück.

Anbieter zum Thema

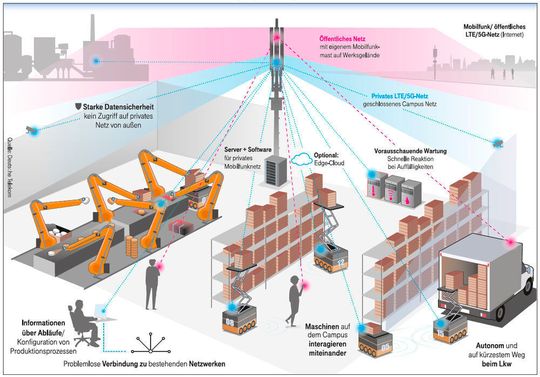

Die EdgAir-Plattform von T-Systems ist eine Private Enterprise Edge-Cloud, die direkt am Einsatzort arbeitet. Durch die Unterstützung verschiedener Netz- und Protokollstandards (5G, Wi-Fi 6, TSN usw.) kann sie direkt an ein Campus-Netz angeschlossen werden. T-Systems verspricht mit EdgAir eine sichere Plattform, die für Echtzeitanwendungen vor Ort („Near Edge“) eine geringe Latenz von weniger als 10 Millisekunden bietet, beispielsweise für die Verarbeitung großer Datenmengen. Das so genannte Far Edge erlaubt Latenzzeiten zwischen zehn und 40 Millisekunden. Zu den Anwendungsmöglichkeiten gehören laut T-Systems, fahrerlose Fahrzeuge (Automated Guided Vehicles) sowie Lösungen für ergänzte und komplett virtuelle Realität (Augmented/Virtual Reality).

EdgAir läuft in einem geschlossenen Unternehmensnetzwerk, kann aber mit einer öffentlichen Cloud kombiniert werden, um hybride Cloud-Angebote zu ermöglichen. EdgAir kann auch Analysen bereitstellen, die es den Teams ermöglichen, Performance und andere kritische Informationen in Echtzeit zu bewerten, und unterstützt die Standards und Arbeitslasten der Betriebstechnologie (OT).

„Anspruchsvolle Anforderungen an Edge-Compute von 5G-, IoT- und MEC-Anwendungen stellen eine Herausforderung für diejenigen dar, die versuchen, Cloud-Native-Lösungen zu implementieren“, sagte Paul Miller, Vice President of Telecommunications bei Wind River. „Die Wind River Cloud Platform adressiert die Komplexität der Bereitstellung und Verwaltung einer physisch verteilten, nativen 5G-Cloud-Infrastruktur. Gemeinsam mit T-Systems können wir Kunden dabei unterstützen, eine betriebsfähige, Edge-fähige Cloud zu schaffen, die Tausende von Knoten unterstützt.“

„Da die Industrie immer mehr in den Einsatz automatisierter und intelligenter Anwendungen wie autonome Fahrzeuge, Fabrikautomation und Logistik oder Augmented Reality eintaucht, steigt der Bedarf an noch größerer Sicherheit und leistungsfähigem Edge-Computing“, so Thomas Weber, Vice President PaaS, BigData und Edge bei T-Systems. „Durch die Zusammenarbeit mit Wind River stellt T-Systems eine sichere Plattform mit extrem niedriger Latenzzeit bereit, die Unternehmen bei der Erschließung intelligenter Echtzeitanwendungen für grenzenlose Möglichkeiten unterstützt.“

Hochskalierbare Cloud-Plattform

Wind Rivers Cloud Platform kombiniert eine vollständig native Cloud-Architektur mit einer Kubernetes- und Container-basierten Architektur und ist ein hochleistungsfähiges Angebot für die Verwaltung von Edge-Cloud-Infrastrukturen. Sie nutzt das Open-Source-Projekt StarlingX, um Day 1 und Day 2 Abläufe zu vereinfachen, indem sie das Single-Pane-of-Glass (SPoG)-Management und die automatische Bereitstellung von Tausenden von Knoten unabhängig von deren Standort ermöglicht. Die Plattform bietet außerdem vollautomatische und „hitless“ Software-Updates und -Upgrades in einer geo-verteilten Cloud mit Rollback-Funktionen. Die Plattform skaliert von einem einzelnen Rechenknoten am Netzwerkrand, um extrem kostengünstige Implementierungen bis hin zu Tausenden von Knoten zu ermöglichen und so die steigenden Anforderungen hochwertiger Anwendungen zu erfüllen.

EdgAir basiert auf OpenStack. Die Open-Source-Software vermeidet eine Silo-Bildung (Vendor Lock-in). Kunden können ihre IoT-Anwendungen und Applikationen über vorgefertigte Konnektoren ankoppeln. Die Anwendungen selbst laufen als virtuelle Maschinen oder in Docker-Containern in Form von Microservices. Damit sind sie unabhängig von der darunterliegenden Infrastruktur. So können Administratoren Microservices bei Problemen oder Auffälligkeiten einzeln ansteuern. Sie müssen das System nicht komplett herunterfahren. Orchestriert werden die Container über Kubernetes.

(ID:46350361)

:quality(80)/p7i.vogel.de/wcms/b8/20/b8203d9f2b6f6e61bff6c3fda15042d3/0128235802v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/79/90/79901d8c1934b11223a53cb900b1aa85/das-20building-2092-20bei-20der-20microsoft-zentrale-20in-20redmond-20--20quelle-20coolcaesar-20via-20wikimedia-20commons-5184x2915v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/31/92/3192d2bddbdb052afd8904128dd7aec1/0123884994v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/b0/42/b04293b683f177fa6c781c1e00e1770f/0122968330v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ba/d7/bad734452b1b8360591396b49da37b72/0130644400v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/cc/53/cc53ebfd9f45b28eb918a8098b63846b/0127825678v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ac/ea/acea3ca6c15e0bd261c8bde5d3fe7bfb/0127825678v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/93/d9/93d9211463a0af86eff0b83c359cd880/0127528428v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d9/c1/d9c121f0680f16e547502038f5c26481/0130027942v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/75/3d/753d0fa44b344d363e25c91dc0752635/0129134302v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ef/9a/ef9a10566eaa807a8fdad9cbff80246f/0126533084v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/47/f5/47f5a305c48bfcaf3daae7e6b7478a0f/0131065910v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/a9/a8/a9a87353e49fb7432ce35aef31d06ad6/0130134372v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/1e/b2/1eb228a11ff793648167b84e30da4eb3/0129529708v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/df/0a/df0a16a8a74519cf7e4ae26b468a8326/0129511289v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/23/23/2323167fce16d7a31011ac17a97933c9/0129855253v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/5f/e0/5fe00181ea62f890f53af36d03782612/0129630465v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6f/92/6f92cb791d67b866650a432e847ad8f2/0129693241v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/f3/0e/f30ed4c0e762a250c39013170f3d154a/0131041847v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2e/b2/2eb2a82d215c72f59c1fde532c092e87/0131010297v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/44/a7/44a7069736629cbbfa41b74af865ec67/0130322397v4.jpeg)

:quality(80)/p7i.vogel.de/wcms/eb/23/eb23785d23e0a13df6f6344f6d880bd0/0129487941v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/71/8c/718c0df3cae4339bb3ea0b799b53e1cd/0131015301v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/b1/21/b12113e8d5357060593e78ad3e396773/0130960706v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/0d/e8/0de88d8542d1b2b5deddf20789bccc2c/0130537290v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/4c/f0/4cf066b46a5fcfc430a2454a5e82e801/0129279386v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/9f/9d/9f9d8357928662c1173bad86e63f0fb0/0126749087v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/27/b9/27b9cfbb678630047f85e1adc55f7df7/0114455762.jpeg)

:quality(80)/p7i.vogel.de/wcms/4d/96/4d9621a180cfee96ba85d2da83163461/0105948132.jpeg)

:quality(80)/p7i.vogel.de/wcms/34/05/3405327567eb345e9c0c326a590cd9ae/0105886699.jpeg)

:quality(80)/p7i.vogel.de/wcms/22/89/22896600c7f19a5813fa824ee8207dd4/0122524970v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/cf/e7cf5a22f39eddc3235f047c566b747e/0122159010v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/43/c4/43c4067994de48347a260c6191e88528/0103046501v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/74/a1/74a1fcd5d60af69422390e97fbf77dcd/0109296819.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/66/f6/66f673630a98a/logo-mc-rgb-300x300.png)

:fill(fff,0)/p7i.vogel.de/companies/66/1c/661cd4860acd6/emlix-logo-300x210mm-150dpi-rgb.png)

:fill(fff,0)/p7i.vogel.de/companies/5f/bf/5fbfdf326d5dd/rti-logo-color-200px.jpg)

:quality(80)/p7i.vogel.de/wcms/31/c3/31c3c246d0b289ecb050ee67dd8ea456/0125490401v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/cc/53/cc53ebfd9f45b28eb918a8098b63846b/0127825678v1.jpeg)