Das Akaike Information Criterion

Welches Modell ist für meine Daten am besten geeignet? Diese Frage stellt sich jeder Data Scientist. Mithilfe des seit 1974 in Japan veröffentlichten „Akaike Information Criterion“ (AIC) kann er die Antwort in kurzer Zeit finden.

Anbieter zum Thema

Das Akaike Information Criterion ist eine Schätzfunktion, wie so viele andere Algorithmen. Mit ihm kann man einschätzen, wie hoch der Vorhersagefehler bezüglich Daten außerhalb der Stichprobe ist. Daraus lässt sich die relative Qualität bzw. Genauigkeit von statistischen Modellen für eine vorliegende Datenmenge beurteilen. Der AIC spielt im Machine Learning beim Vorgang der Inferenz eine bedeutende Rolle. Je schneller und genauer die Inferenzvorgänge erfolgen, desto genauer wird voraussichtlich das Modell auf die vorliegenden Daten passen und desto zuverlässiger die Vorhersage oder Erkennungsrate.

Der AIC basiert auf der Informationstheorie. Wird ein statistisches Modell dazu verwendet, den Vorgang darzustellen, der die im Modell verwendeten Daten repräsentiert, wird diese Darstellung kaum jemals exakt sein. Bei der Verwendung des Modells für die Darstellung des Prozesses wird also Information verlorengehen. Die Menge der verlorengegangenen Information lässt sich mithilfe des AIC schätzen. Schnell wird klar: Je weniger ein Modell an Information verliert, desto höher ist die Qualität dieses Modells.

Wie lässt sich die verlorene Datenmenge feststellen? AIC betrachtet das Gleichgewicht zwischen zwei polaren Aspekten von Modellen: Auf der Seite die Einfachheit des Modells, auf der anderen die maximale Anpassungsgüte des Modells auf die vorliegende Datenmenge. Es besteht das Risiko, ein Modell zu genau an die Datenmenge anzupassen (Overfitting) und andererseits zu geringer Anpassungsgüte (Underfitting), die zu Ungenauigkeiten führen würde.

Man beachte, dass das AIC nichts über die absolute Qualität eines Modells aussagt, sondern über die Qualität in Relation zu anderen Modellen. Wenn also alle Kandidaten nur ungenügend passen, wird das AIC keine Warnung ausgeben. Um die absolute Modellqualität zu ermitteln, ist es daher empfehlenswerte Praxis, eine Validierung auszuführen. Dazu gehört die Bewertung der Restwerte eines Modells, die vielleicht zufällig aussehen, und die Vorhersagen des Modells zu testen. Mehr zu diesem Thema findet im Wikipedia-Artikel über Validierung von statistischen Modellen.

Bedeutung für die Statistik

Bemerkenswert ist die Bedeutung des Akaike-Informationskriteriums AIC für die heutige Statistik und wie sie entstand. Das AIC wurde nach dem japanischen Statistiker Hirotsugu Akaike (1927-2009) benannt, der es ursprünglich im Hinblick auf Lineare Regression formulierte. Er trug es bereits 1971 auf einem Symposium in Armenien vor, dessen Protokolle 1973 erschienen.

Als formalen Beitrag veröffentlichte es Akaike aber erst 1974. Weil der Artikel auf Japanisch verfasst war, nahm die Welt erst anno 2002 Notiz davon, als die englischsprachige Veröffentlichung in einem verbreiteten Fachbuch von Burnham & Anderson erfolgte, allerdings mit Ergänzungen von Takeuchi. Dieses Buch wurde seitdem laut Google Scholar mehr als 48.000 Mal zitiert. Seit 2014 wurde das AIC laut Google Scholar selbst über 150.000 Mal zitiert.

Definition

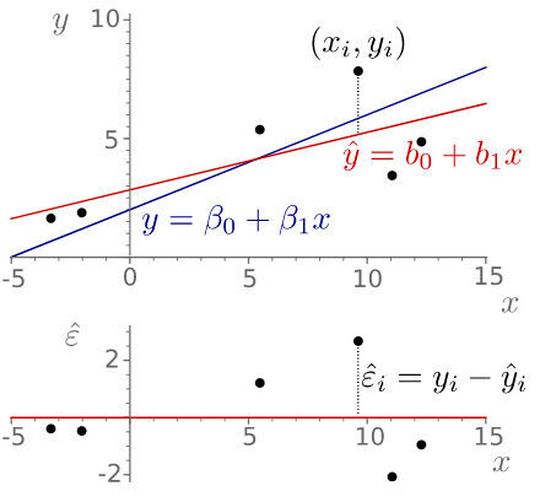

Das AIC wird laut Gablers Wirtschaftslexikon mit AIC = ln(RSS/n) + 2(K+1)/n berechnet, wobei RSS die Residuenquadratesumme (Residuen) des geschätzten Modells, n der Stichprobenumfang und K die Anzahl der erklärenden Variablen im Modell sind. ln symbolisiert den natürlichen Logarithmus. Der Vergleich zweier Modellspezifikationen anhand von AIC erfolgt analog zum eng verwandten Schwarz-Informationskriterium.

Hat man eine Anzahl von Modellkandidaten für eine Datenmenge, dann ist das bevorzugte Modell das mit dem niedrigsten AIC-Wert. AIC belohnt so einerseits die Passgenauigkeit eines Modells, bestraft aber eine übermäßig hohe Anzahl von Parametern. Diese Strafe entmutigt Überanpassung (s. o.), obwohl eine höhere Anzahl von Parametern zu höherer Passgenauigkeit führt (weil sie helfen, die Datenmenge genauer zu beschreiben).

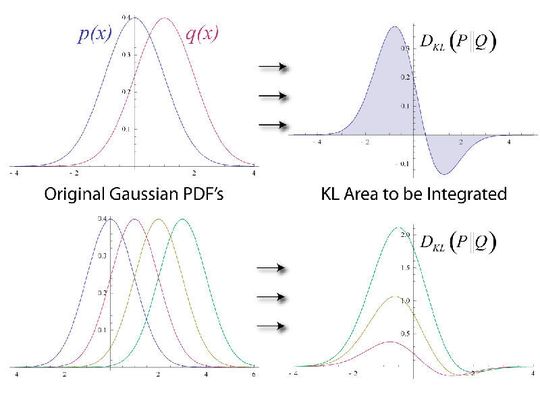

Der oben erwähnte, unbekannte Prozess f, der Daten erzeugt, aber unterwegs wieder Information verliert, soll von den zwei Modellkandidaten g1 und g2 beschrieben werden. Würden wir f kennen, könnten wir die Information, die wir durch den Gebrauch von g1 verloren haben, mithilfe der Kullback-Leibler-Divergenz DKL berechnen. Analog dazu könnten wir den Datenverlust bei f im Modell g2 berechnen. Durch Vergleichen würden wir entscheiden können, welches der beiden Modelle weniger Datenverlust aufweist und das günstigere wählen.

Wir kennen nach wie vor f nicht. Doch mithilfe von AIC können wir relativ schätzen, wie viel Information in g1 bzw. g2 verlorengeht. Die Schätzung ist indes nur eine asymptotische Annäherung. Insbesondere dann, wenn die Menge an vorliegenden Datenpunkte klein ist, dann ist häufig eine Korrektur notwendig, beispielsweise mit AICc. Der Vergleich zum Bayes Information Criterion (BIC) liegt nahe, aber statt der Strafe 2k in AIC liegt beim BIC die Strafe bei ln(n)k.

:quality(80)/images.vogel.de/vogelonline/bdb/1745300/1745348/original.jpg)

Mit einfacher Regressionsanalyse Mittelwerte in Prognosen ermitteln

:quality(80)/images.vogel.de/vogelonline/bdb/1602200/1602206/original.jpg)

So deckt der Local Outlier Factor Anomalien auf

:quality(80)/images.vogel.de/vogelonline/bdb/1618400/1618434/original.jpg)

Der Greedy-Algorithmus

:quality(80)/images.vogel.de/vogelonline/bdb/1580900/1580976/original.jpg)

Der Rete-Algorithmus: Speed für Mustererkennung

Dieser Beitrag erschien zuerst auf unserem Partnerportal Bigdata-Insider.de.

(ID:46901730)

:quality(80)/p7i.vogel.de/wcms/b8/20/b8203d9f2b6f6e61bff6c3fda15042d3/0128235802v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/79/90/79901d8c1934b11223a53cb900b1aa85/das-20building-2092-20bei-20der-20microsoft-zentrale-20in-20redmond-20--20quelle-20coolcaesar-20via-20wikimedia-20commons-5184x2915v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/31/92/3192d2bddbdb052afd8904128dd7aec1/0123884994v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/b0/42/b04293b683f177fa6c781c1e00e1770f/0122968330v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ba/d7/bad734452b1b8360591396b49da37b72/0130644400v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/cc/53/cc53ebfd9f45b28eb918a8098b63846b/0127825678v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ac/ea/acea3ca6c15e0bd261c8bde5d3fe7bfb/0127825678v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/93/d9/93d9211463a0af86eff0b83c359cd880/0127528428v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d9/c1/d9c121f0680f16e547502038f5c26481/0130027942v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/75/3d/753d0fa44b344d363e25c91dc0752635/0129134302v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ef/9a/ef9a10566eaa807a8fdad9cbff80246f/0126533084v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/47/f5/47f5a305c48bfcaf3daae7e6b7478a0f/0131065910v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/a9/a8/a9a87353e49fb7432ce35aef31d06ad6/0130134372v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/1e/b2/1eb228a11ff793648167b84e30da4eb3/0129529708v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/df/0a/df0a16a8a74519cf7e4ae26b468a8326/0129511289v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/23/23/2323167fce16d7a31011ac17a97933c9/0129855253v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/5f/e0/5fe00181ea62f890f53af36d03782612/0129630465v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6f/92/6f92cb791d67b866650a432e847ad8f2/0129693241v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/f3/0e/f30ed4c0e762a250c39013170f3d154a/0131041847v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2e/b2/2eb2a82d215c72f59c1fde532c092e87/0131010297v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/44/a7/44a7069736629cbbfa41b74af865ec67/0130322397v4.jpeg)

:quality(80)/p7i.vogel.de/wcms/eb/23/eb23785d23e0a13df6f6344f6d880bd0/0129487941v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/71/8c/718c0df3cae4339bb3ea0b799b53e1cd/0131015301v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/b1/21/b12113e8d5357060593e78ad3e396773/0130960706v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/0d/e8/0de88d8542d1b2b5deddf20789bccc2c/0130537290v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/4c/f0/4cf066b46a5fcfc430a2454a5e82e801/0129279386v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/9f/9d/9f9d8357928662c1173bad86e63f0fb0/0126749087v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/27/b9/27b9cfbb678630047f85e1adc55f7df7/0114455762.jpeg)

:quality(80)/p7i.vogel.de/wcms/4d/96/4d9621a180cfee96ba85d2da83163461/0105948132.jpeg)

:quality(80)/p7i.vogel.de/wcms/34/05/3405327567eb345e9c0c326a590cd9ae/0105886699.jpeg)

:quality(80)/p7i.vogel.de/wcms/22/89/22896600c7f19a5813fa824ee8207dd4/0122524970v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/cf/e7cf5a22f39eddc3235f047c566b747e/0122159010v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/43/c4/43c4067994de48347a260c6191e88528/0103046501v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/74/a1/74a1fcd5d60af69422390e97fbf77dcd/0109296819.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/66/f6/66f673630a98a/logo-mc-rgb-300x300.png)

:fill(fff,0)/p7i.vogel.de/companies/63/8f/638f6ed06f4c8/parasoft-logo-2018.png)

:fill(fff,0)/p7i.vogel.de/companies/5f/bf/5fbfdf326d5dd/rti-logo-color-200px.jpg)

:quality(80)/p7i.vogel.de/wcms/5f/e0/5fe00181ea62f890f53af36d03782612/0129630465v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/44/ae/44ae9d39a71459d2159041970c5af967/0129272409v2.jpeg)